- 作者:老汪软件技巧

- 发表时间:2024-12-31 07:04

- 浏览量:213

我目前正在参加“书生大模型实战营”。这是一个旨在帮助学员掌握大模型开发和应用的实战课程。

为了更好地记录完成过程,我根据官方提供的教程文档提取了核心步骤,并去掉了详细的背景知识介绍和说明,这样后续作为一个手册查找起来会更加直观。

但建议大家在实际学习过程中还是多看看原文,因为原文档确实非常的详细和完整,方便了解每一步的具体原因和背后的原理,这样有助于更牢固地掌握知识,提高实战能力。

进阶岛-第3关

本地环境:Win11。

原文:/InternLM/Tu…

完成任务步骤记录准备工作

目标:完成环境搭建及验证。

完成所需时间:20分钟。

步骤:

开发机

启动开发机,选择Cuda12.2-conda镜像,并连接上开发机即可。

教程中建议开发机资源配置采用:30% A100 * 1。

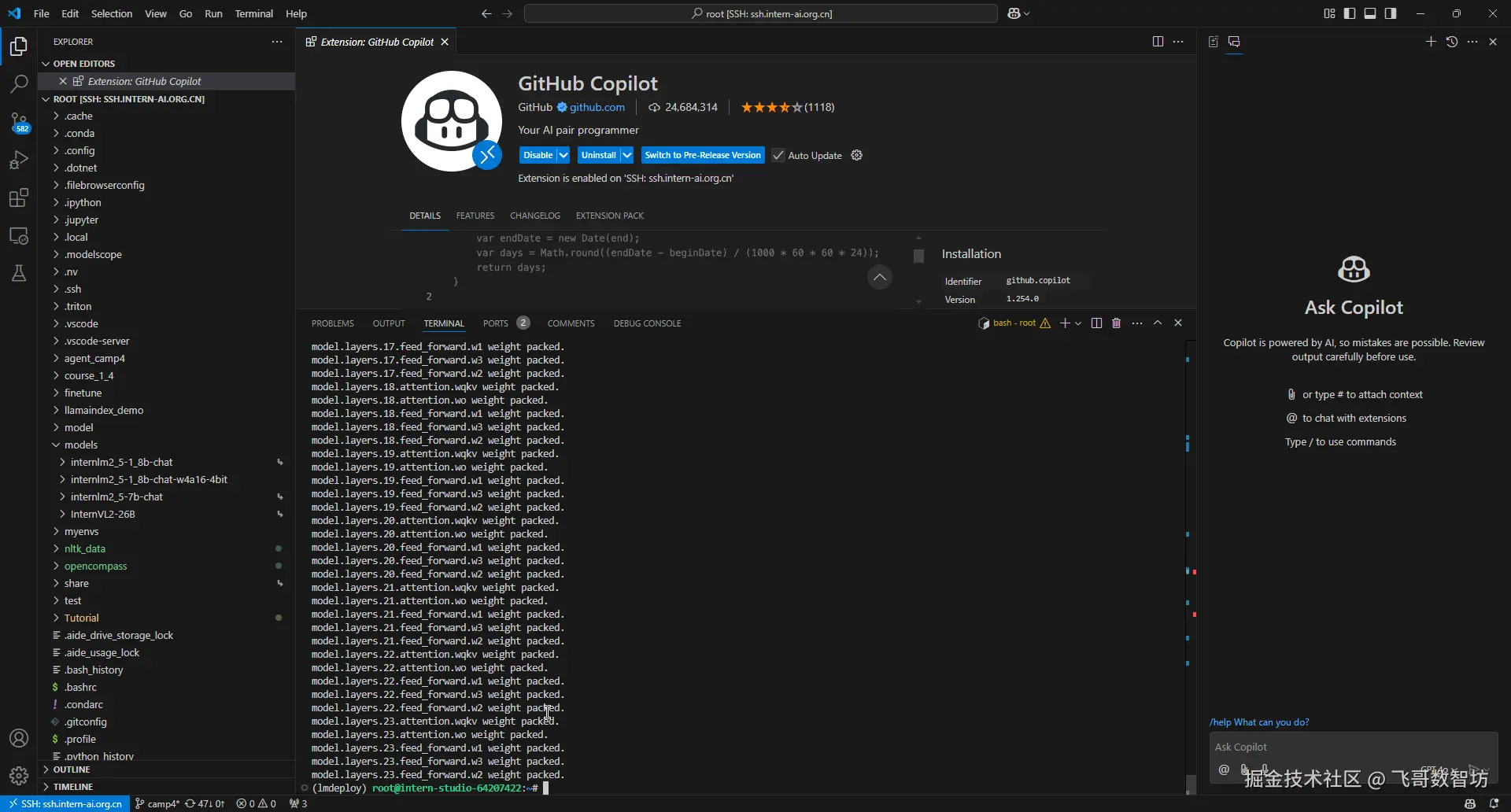

我更喜欢VS Code连接开发机,后续截图都以VS Code为准。

基础环境

运行以下命令安装基础环境。

conda create -n lmdeploy python=3.10 -y

conda activate lmdeploy

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia -y

pip install timm==1.0.8 openai==1.40.3 lmdeploy[all]==0.5.3

pip install datasets==2.19.2

模型获取

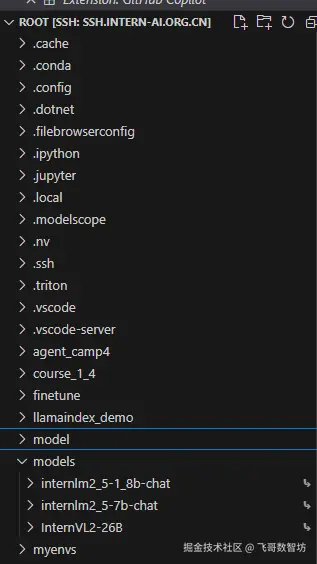

创建文件夹并设置开发机共享目录的软链接。

mkdir /root/models

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2_5-7b-chat /root/models

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2_5-1_8b-chat /root/models

ln -s /root/share/new_models/OpenGVLab/InternVL2-26B /root/models

验证模型

通过以下命令启动模型,然后即可在终端与大模型进行交流,后续任务使用大模型internlm2_5-1_8b-chat,我这里直接采用相同模型方便后续对比显存情况。

lmdeploy chat /root/models/internlm2_5-1_8b-chat

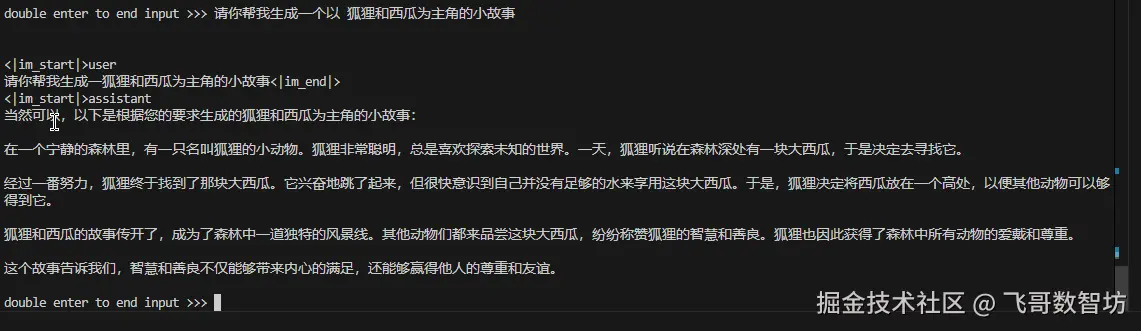

执行结果如下:

通过输入“请你帮我生成一个狐狸和西瓜为主角的小故事”测试大模型效果。

任务一:量化部署

目标:使用结合W4A16量化与kv cache量化的internlm2_5-1_8b-chat模型封装本地API并与大模型进行一次对话。

完成所需时间:120分钟,其中模型量化1小时左右。

步骤:

了解前置知识

最大kv cache缓存大小:

kv cache是一种缓存技术,通过存储键值对的形式来复用计算结果,以达到提高性能和降低内存消耗的目的。在大规模训练和推理中,kv cache可以显著减少重复计算量,从而提升模型的推理速度。理想情况下,kv cache全部存储于显存,以加快访存速度。

模型在运行时,占用的显存可大致分为三部分:模型参数本身占用的显存、kv cache占用的显存,以及中间运算结果占用的显存。LMDeploy的kv cache管理器可以通过设置--cache-max-entry-count参数,控制kv缓存占用剩余显存的最大比例。默认的比例为0.8。

kv cache int4/int8 量化:

自 v0.4.0 起,LMDeploy 支持在线 kv cache int4/int8 量化,量化方式为 per-head per-token 的非对称量化。此外,通过 LMDeploy 应用 kv 量化非常简单,只需要设定quant_policy 和cache-max-entry-count参数。

目前,LMDeploy 规定 quant_policy=4 表示 kv int4 量化,quant_policy=8 表示 kv int8 量化。

W4A16 模型量化:

准确说,模型量化是一种优化技术,旨在减少机器学习模型的大小并提高其推理速度。量化通过将模型的权重和激活从高精度(如16位浮点数)转换为低精度(如8位整数、4位整数、甚至二值网络)来实现。

W4A16的量化配置意味着:

模型量化

量化模型,并存储量化模型。

根据教程,当前版本的 datasets3.0 无法下载calibrate数据集,不然会出现TypeError: 'NoneType' object is not callable错误。

pip install datasets==2.19.2

lmdeploy lite auto_awq \

/root/models/internlm2_5-1_8b-chat \

--calib-dataset 'ptb' \

--calib-samples 128 \

--calib-seqlen 2048 \

--w-bits 4 \

--w-group-size 128 \

--batch-size 1 \

--search-scale False \

--work-dir /root/models/internlm2_5-1_8b-chat-w4a16-4bit

命令解释:

执行结果:

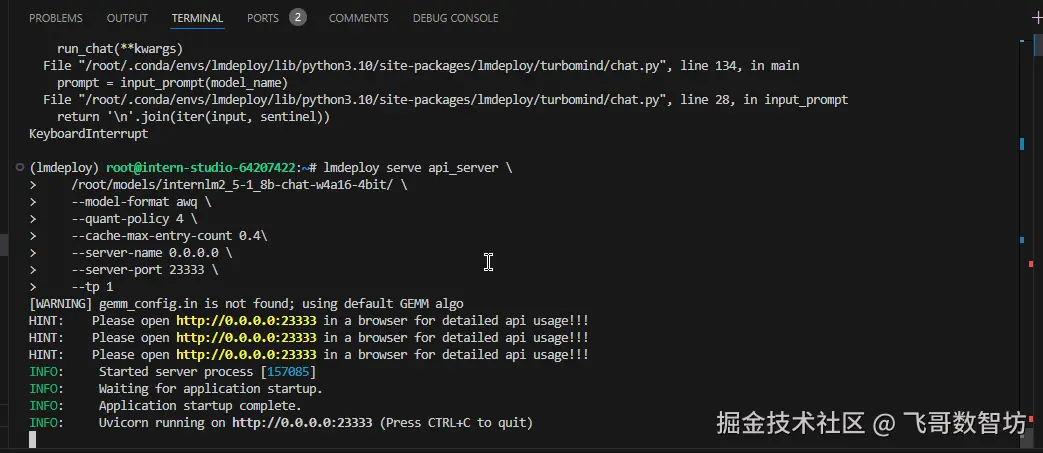

量化模型部署

启用W4A16 量化+ KV cache+KV cache 量化后的模型。

lmdeploy serve api_server \

/root/models/internlm2_5-1_8b-chat-w4a16-4bit/ \

--model-format awq \

--quant-policy 4 \

--cache-max-entry-count 0.4\

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

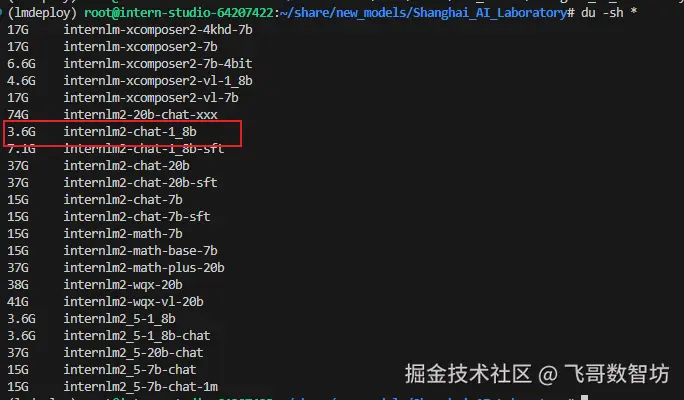

量化前后模型文件大小:

前后对比:3.6G对1.5G,还是很明显的。

量化前:

cd /root/share/new_models/Shanghai_AI_Laboratory/

du -sh *

量化后

cd /root/models/

du -sh *

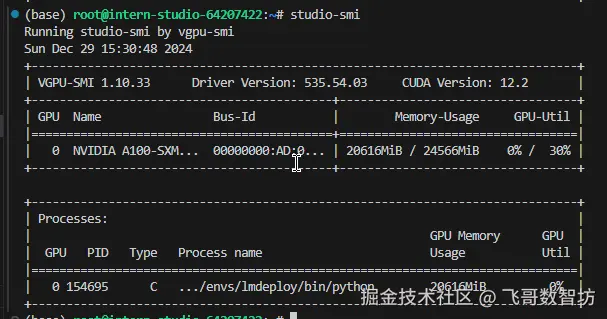

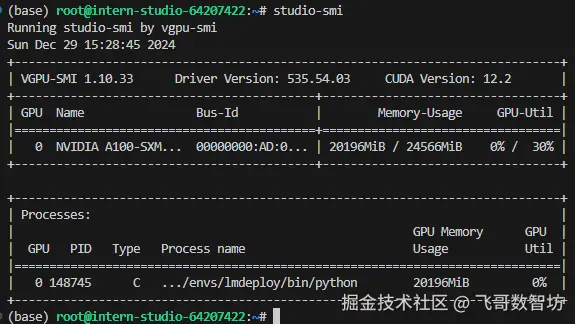

量化前后显存占用:

前后对比:20.616G对20.196G,估计是是1.8B规模太小,有优势,但不是很大。

量化前:

量化后:

为了保持单一变量,量化模型也通过chat模式启动。

lmdeploy chat /root/models/internlm2_5-1_8b-chat-w4a16-4bit/ --model-format awq

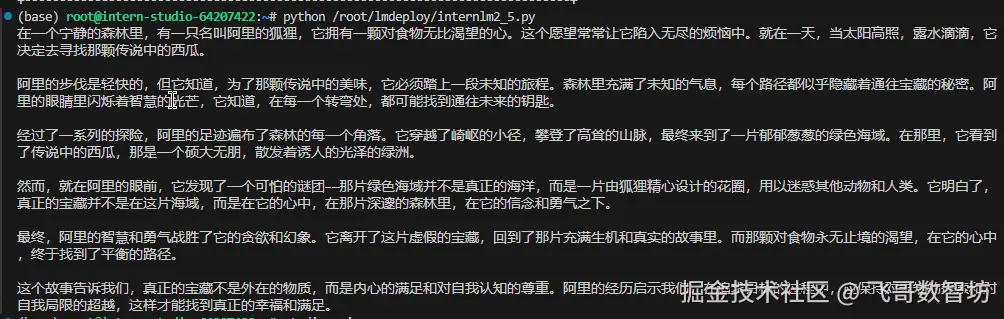

效果

新建文件/root/lmdeploy/internlm2_5.py,代码如下:

# 导入openai模块中的OpenAI类,这个类用于与OpenAI API进行交互

from openai import OpenAI

# 创建一个OpenAI的客户端实例,需要传入API密钥和API的基础URL

client = OpenAI(

api_key='YOUR_API_KEY',

# 替换为你的OpenAI API密钥,由于我们使用的本地API,无需密钥,任意填写即可

base_url="http://0.0.0.0:23333/v1"

# 指定API的基础URL,这里使用了本地地址和端口

)

# 调用client.models.list()方法获取所有可用的模型,并选择第一个模型的ID

# models.list()返回一个模型列表,每个模型都有一个id属性

model_name = client.models.list().data[0].id

# 使用client.chat.completions.create()方法创建一个聊天补全请求

# 这个方法需要传入多个参数来指定请求的细节

response = client.chat.completions.create(

model=model_name,

# 指定要使用的模型ID

messages=[

# 定义消息列表,列表中的每个字典代表一个消息

{"role": "system", "content": "你是一个友好的小助手,负责解决问题."},

# 系统消息,定义助手的行为

{"role": "user", "content": "帮我讲述一个关于狐狸和西瓜的小故事"},

# 用户消息,询问时间管理的建议

],

temperature=0.8,

# 控制生成文本的随机性,值越高生成的文本越随机

top_p=0.8

# 控制生成文本的多样性,值越高生成的文本越多样

)

# 打印出API的响应结果

print(response.choices[0].message.content)

/root/lmdeploy/internlm2_5.py

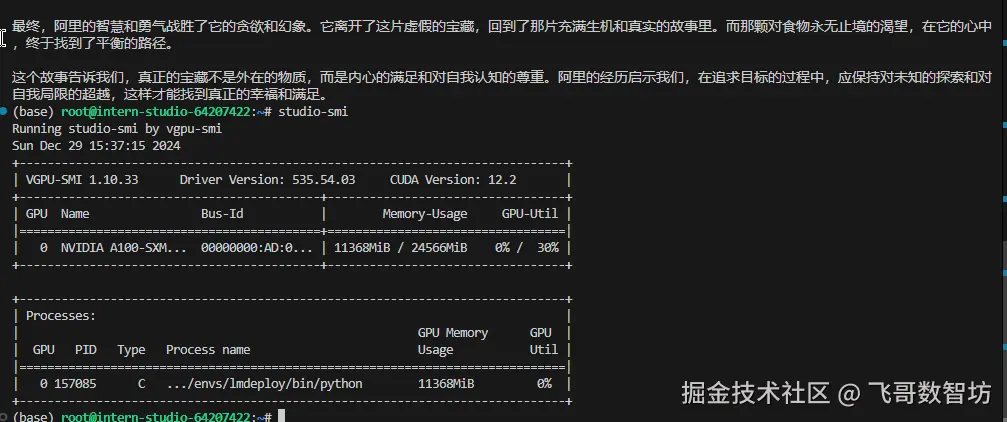

运行结果:

显存:

任务二:使用Function call完成"加"与"乘"函数调用

目标:使用Function call功能让大模型完成一次简单的"加"与"乘"函数调用。

完成所需时间:10分钟。

步骤:

启动大模型API

参考前文,直接启动一个模型作为API,function call要基于模型进行。

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat \

--model-format hf \

--quant-policy 0 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

function call调用

新建文件/root/lmdeploy/internlm2_5_func.py,代码如下:

from openai import OpenAI

def add(a: int, b: int):

return a + b

def mul(a: int, b: int):

return a * b

tools = [{

'type': 'function',

'function': {

'name': 'add',

'description': 'Compute the sum of two numbers',

'parameters': {

'type': 'object',

'properties': {

'a': {

'type': 'int',

'description': 'A number',

},

'b': {

'type': 'int',

'description': 'A number',

},

},

'required': ['a', 'b'],

},

}

}, {

'type': 'function',

'function': {

'name': 'mul',

'description': 'Calculate the product of two numbers',

'parameters': {

'type': 'object',

'properties': {

'a': {

'type': 'int',

'description': 'A number',

},

'b': {

'type': 'int',

'description': 'A number',

},

},

'required': ['a', 'b'],

},

}

}]

messages = [{'role': 'user', 'content': 'Compute (3+5)*2'}]

client = OpenAI(api_key='YOUR_API_KEY', base_url='http://0.0.0.0:23333/v1')

model_name = client.models.list().data[0].id

response = client.chat.completions.create(

model=model_name,

messages=messages,

temperature=0.8,

top_p=0.8,

stream=False,

tools=tools)

print(response)

func1_name = response.choices[0].message.tool_calls[0].function.name

func1_args = response.choices[0].message.tool_calls[0].function.arguments

func1_out = eval(f'{func1_name}(**{func1_args})')

print(func1_out)

messages.append({

'role': 'assistant',

'content': response.choices[0].message.content

})

messages.append({

'role': 'environment',

'content': f'3+5={func1_out}',

'name': 'plugin'

})

response = client.chat.completions.create(

model=model_name,

messages=messages,

temperature=0.8,

top_p=0.8,

stream=False,

tools=tools)

print(response)

func2_name = response.choices[0].message.tool_calls[0].function.name

func2_args = response.choices[0].message.tool_calls[0].function.arguments

func2_out = eval(f'{func2_name}(**{func2_args})')

print(func2_out)

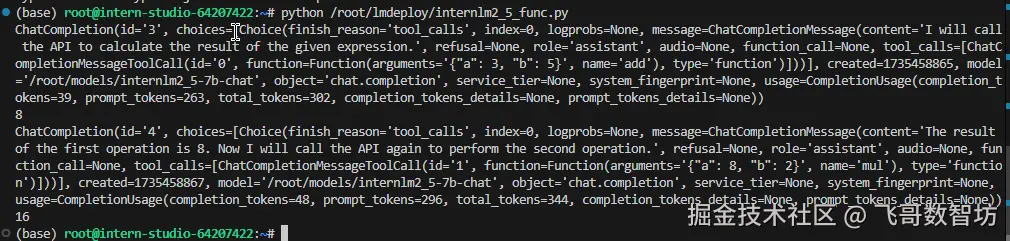

效果

运行。

/root/lmdeploy/internlm2_5_func.py